Umfragen erreichen immer weniger Menschen. Und die, die antworten, kreuzen sich durch, statt nachzudenken. Das Format, das jahrzehntelang als Standardwerkzeug für Nutzer-Feedback galt, stößt an eine strukturelle Grenze – und eine kontrollierte Studie der Universität Mannheim zeigt, dass KI-moderierte Interviews bei identischen Fragen deutlich reichere, differenziertere und sauberere Daten liefern als klassische Fragebögen.

Wer heute ein Produkt verbessern will, greift fast reflexhaft zur Umfrage. Zehn Fragen, ein Likert-Skala-Block, ein offenes Textfeld am Ende. Der Vorteil liegt auf der Hand: schnell erstellt, günstig distribuiert, quantifizierbar. Tausende Antworten in einer Woche, Charts im Quartalsreport – alles wirkt valide und datengetrieben.

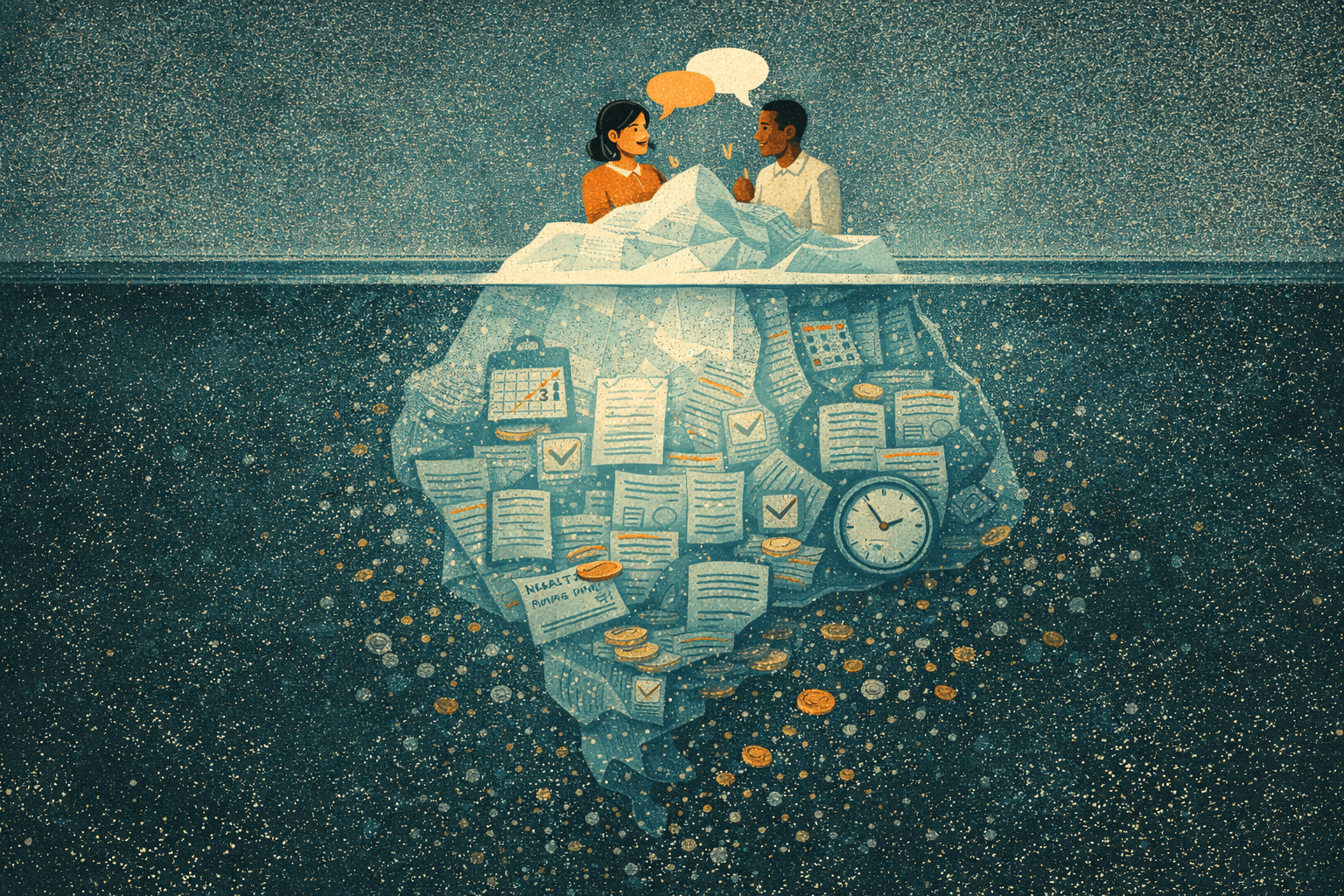

Das Problem zeigt sich erst, wenn man mit den Ergebnissen arbeiten will. Die Zahlen sagen: Zwei Drittel sind zufrieden. Aber warum das andere Drittel unzufrieden ist, bleibt unklar: Was genau sie stört, wo der Moment der Frustration liegt, welche Erwartung nicht erfüllt wurde – all das steht nicht in den Daten, weil das Format es nicht hergibt.

Was Umfragen nie konnten

Umfragen messen Verteilungen. Sie zeigen, wie viele Menschen eine bestimmte Antwort wählen. Was sie nicht zeigen: warum jemand so antwortet, wie er antwortet. Der Unterschied klingt technisch; er ist fundamental.

Eine Likert-Skala von 1 bis 5 zwingt eine differenzierte Meinung in eine Kategorie. Dabei gehen laut einer PLOS-ONE-Studie signifikante Informationen verloren – die diskrete Kategorisierung vereinfacht, was sich nicht vereinfachen lässt. Dazu kommt der Social-Desirability-Bias: Menschen antworten so, wie sie glauben, dass es von ihnen erwartet wird, nicht so, wie sie tatsächlich denken. PNAS-Forscher zeigten, dass diese Verzerrungen kein Randphänomen sind, sondern Selbstberichte systematisch verfälschen.

Dann ist da die sogenannte "Acquieszenz" – die Tendenz, Aussagen zuzustimmen, unabhängig vom Inhalt. Und die Vermeidung von Extrempositionen, besonders bei sensiblen Themen. Was am Ende in der Datenbank steht, ist nicht die Meinung des Befragten, sondern ein Artefakt des Formats.

Das offene Textfeld am Ende der Umfrage "Möchten Sie noch etwas ergänzen?" soll genau diese Lücke schließen. In der Praxis tippt dort fast niemand mehr als einen Satz, wenn überhaupt. Wer 15 Minuten Ankreuzfelder hinter sich hat, investiert keine weitere Minute in Freitext.

Die Zahlen dahinter

Die Response-Raten von Surveys fallen seit zwei Jahrzehnten. Was Pew Research für Telefonumfragen dokumentierte – ein Rückgang von 36 auf sechs Prozent zwischen 1997 und 2018 –, wiederholt sich jetzt bei Online-Umfragen. E-Mail-basierte Surveys erreichen laut Clootrack noch 15 bis 25 Prozent der Empfänger, Tendenz fallend.

Wer überhaupt noch antwortet, tut es zunehmend halbherzig: 70 Prozent der Befragten haben schon einmal eine Umfrage abgebrochen, bevor sie fertig waren. Die Daten, die am Ende in der Auswertung landen, bilden nicht Meinungen ab, sondern Ungeduld.

Eine kontrollierte Studie der Universität Mannheim macht den Unterschied messbar. Aylin Idrizovski und Dr. Florian Stahl ließen je 100 Personen dieselben Fragen beantworten – eine Hälfte per klassischem Online-Fragebogen, die andere in einem KI-moderierten Interview. Das Interview-Format erzeugte 39 Prozent mehr Wörter pro Antwort, 36 Prozent mehr identifizierte Themen und eine deutlich höhere lexikalische Vielfalt. Sinnlose Antworten, sogenannter Gibberish, traten bei den Interviews überhaupt nicht auf; bei den Fragebögen in zehn Prozent der Fälle.

Die Teilnehmer bewerteten die KI-Interviews außerdem mit höherer Zufriedenheit, berichteten von einem stärkeren Gefühl des Gehörtwerdens und zeigten mehr Vertrauen in den Umgang mit ihren Daten.

Was KI-moderierte Interviews anders machen

Ein Fragebogen ist ein Monolog mit Ankreuzoptionen; ein Interview ist ein Gespräch. Die Art der Information, die dabei entsteht, ist eine grundlegend andere.

In einem KI-moderierten Interview antwortet der Teilnehmer auf eine offene Frage – und die KI fragt nach. Nicht mit einer vordefinierten Folgefrage, sondern mit einer, die sich aus der Antwort ergibt. Wenn jemand sagt „Der Checkout war frustrierend", fragt die KI nicht „Wie frustrierend auf einer Skala von 1 bis 5?", sondern „Was genau hat dich frustriert?" Bleibt die Antwort darauf oberflächlich, fragt sie nochmal. Fünf, sechs, sieben Ebenen tief, bis der eigentliche Grund auf dem Tisch liegt.

Das funktioniert, weil KI keine Agenda hat. Ein menschlicher Interviewer bringt Hypothesen mit, interpretiert Tonfall und Mimik, lenkt unbewusst in Richtungen, die seine Annahmen bestätigen. Das ist kein Vorwurf; es ist ein dokumentiertes Phänomen in der qualitativen Forschung. Die KI folgt der Antwort, nicht ihrer Erwartung.

Dazu kommt die Verfügbarkeit. Ein menschlicher Moderator führt drei bis vier Interviews am Tag, braucht Pausen, hat einen Terminkalender. Eine KI führt hunderte Interviews gleichzeitig, nachts, am Wochenende, in der Sprache des Teilnehmers. Das verändert nicht nur die Geschwindigkeit; es verändert, wer teilnehmen kann.

Qual meets Quant: die neue Mitte

Die Grenze zwischen qualitativer und quantitativer Forschung war immer eine des Aufwands. Qualitativ hieß: tiefe Einblicke, kleine Stichprobe. Quantitativ hieß: breite Verteilungen, keine Tiefe. Man musste sich entscheiden.

Mit KI-moderierten Interviews muss man das nicht mehr. Man kann 200 Menschen ein 30-minütiges Gespräch führen lassen – in 48 Stunden statt in sechs Wochen. Das Ergebnis ist weder ein klassisches Qual-Projekt noch eine Umfrage, sondern etwas dazwischen: qualitative Tiefe in quantitativer Breite.

Bei uns sieht das so aus: Ein Researcher definiert den Interviewleitfaden und die Forschungsfragen. Die KI führt die Gespräche. Die Analyse-Pipeline extrahiert Muster aus den Transkripten – semantische Ähnlichkeiten, Themencluster, Sentiment-Verläufe. Was manuell Wochen dauern würde, liegt nach ein bis zwei Tagen als strukturierter Report vor.

Das verändert die Dynamik von Research-Projekten. Wenn Forschung nicht mehr sechs Wochen und 15.000 Euro kostet, fällt die häufigste Ausrede weg: „Dafür haben wir gerade kein Budget." Forschung wird etwas, das man vor jeder größeren Produktentscheidung machen kann, nicht nur einmal im Quartal.

Wann Surveys noch sinnvoll sind

Surveys sind nicht nutzlos, sondern ein bestimmtes Werkzeug für bestimmte Fragen.

Benchmarking funktioniert mit Surveys gut. Wenn du viermal im Jahr denselben NPS-Fragebogen verschickst und den Trend verfolgst, brauchst du kein Interview. Standardisierte Metriken wie CSAT oder CES haben ihren Wert als Seismograph: Sie zeigen, dass sich etwas verändert hat, auch wenn sie nicht zeigen, was.

Für große demografische Erhebungen, bei denen es um Verteilungen geht – wie viele, wie oft, welche Altersgruppe –, bleibt der Fragebogen die effizientere Methode. Und für Screening-Fragen, die Teilnehmer für vertiefende Gespräche vorqualifizieren sollen, sind kurze Surveys nach wie vor das Mittel der Wahl.

Die Frage ist nicht "Umfrage oder Interview", sondern "Welche Information brauche ich?" Wenn du wissen willst, wie viele deiner Nutzer ein Feature kennen, nimm eine Umfrage. Wenn du wissen willst, warum sie es nicht nutzen, führe ein Gespräch.

Selbst ausprobieren

Wie sich ein KI-moderiertes Interview anfühlt, lässt sich schwer beschreiben. Am besten erlebst du es selbst. Wir führen gerade eine offene Studie durch – 20 Minuten, kein Login, direkt im Browser.

Häufig gestellte Fragen

Können KI-moderierte Interviews Umfragen komplett ersetzen?

Nein. Für standardisiertes Tracking (NPS, CSAT), große demografische Erhebungen und Benchmarking bleiben Surveys das richtige Werkzeug. KI-Interviews ersetzen Surveys dort, wo es um das Warum geht – also überall, wo offene Fragen, Nachfragen und Kontextverständnis entscheidend sind.

Wie valide sind die Ergebnisse von KI-moderierten Interviews?

In einer kontrollierten Studie der Universität Mannheim erzeugten KI-moderierte Interviews bei identischen Fragen signifikant reichere Daten und keine sinnlosen Antworten – bei klassischen Fragebögen lag der Gibberish-Anteil bei zehn Prozent. Die Teilnehmer bewerteten die Interviewerfahrung zudem mit höherer Zufriedenheit als den Fragebogen.

Was kostet ein KI-moderiertes Interview im Vergleich zu einer Umfrage?

Eine Umfrage mit 1.000 Teilnehmern kostet je nach Panel und Komplexität 2.000 bis 10.000 Euro und liefert quantitative Verteilungen. Ein qualitatives Forschungsprojekt mit 10 bis 20 menschlich moderierten Interviews kostet 12.500 bis 25.000 Euro. KI-moderierte Interviews bieten qualitative Tiefe zu einem Bruchteil traditioneller Interviewkosten und können gleichzeitig hunderte Teilnehmer einbeziehen.

Erkennen Teilnehmer, dass sie mit einer KI sprechen?

Ja, und das ist Absicht. Transparenz über den KI-Einsatz ist nicht nur eine rechtliche Anforderung nach EU AI Act, sondern verbessert in der Praxis die Offenheit. Menschen sprechen ehrlicher mit einer KI als mit einem menschlichen Interviewer, weil der Social-Desirability-Bias wegfällt.