Las encuestas llegan cada año a menos personas. Y quienes responden marcan casillas en vez de pensar. El formato que durante décadas sirvió como herramienta estándar para recoger feedback de usuarios está tocando un límite estructural – y un estudio controlado de la Universidad de Mannheim demuestra que las entrevistas moderadas por IA producen datos notablemente más ricos, más diferenciados y más limpios que los cuestionarios tradicionales.

Cuando alguien quiere mejorar un producto, el reflejo es casi automático: lanzar una encuesta. Diez preguntas, un bloque de escalas Likert, un campo de texto libre al final. La ventaja es obvia: rápida de crear, barata de distribuir, fácil de cuantificar. Miles de respuestas en una semana, gráficos en el informe trimestral – todo parece basado en datos y sólido.

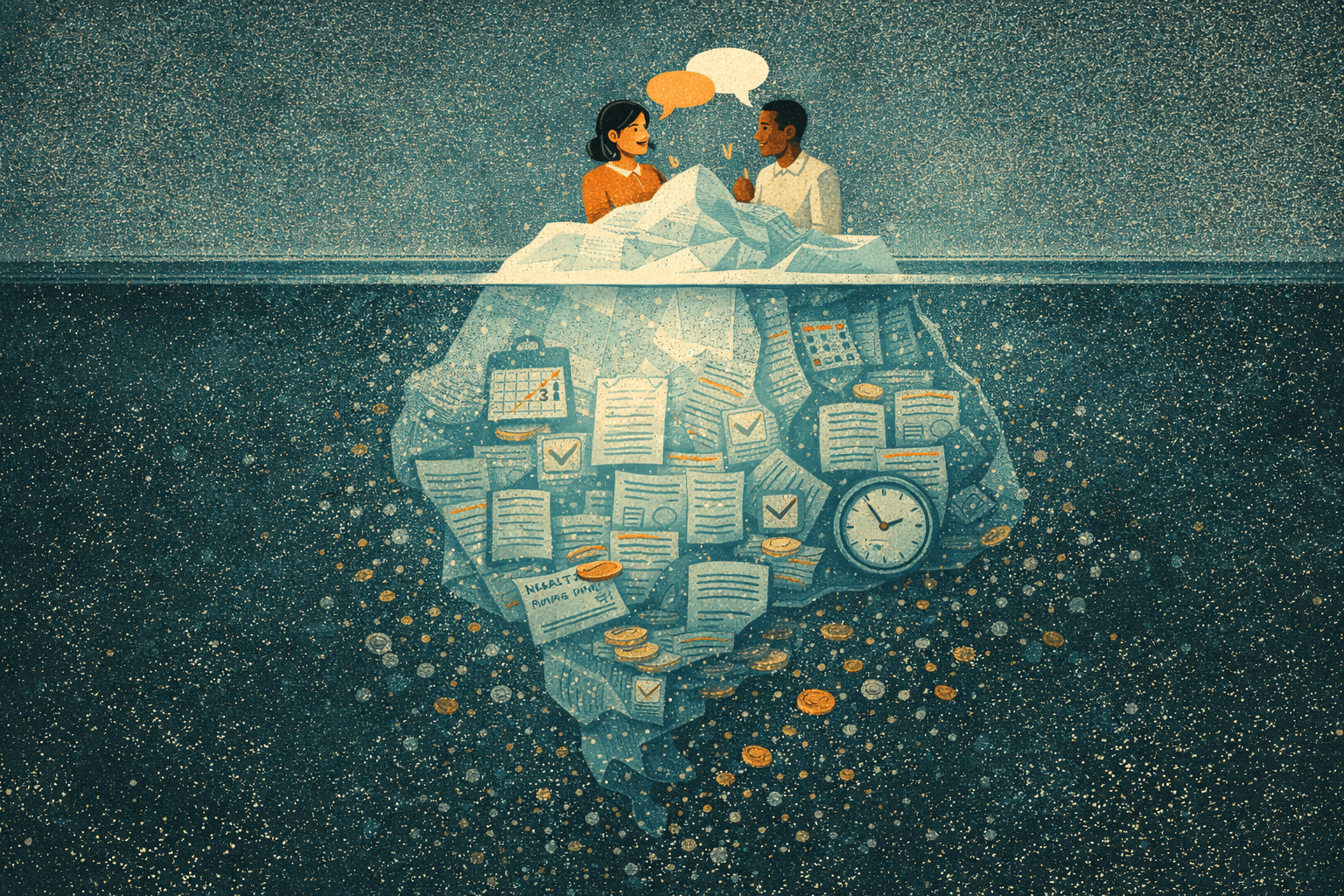

El problema aparece cuando se intenta trabajar con los resultados. Los números dicen: dos tercios están satisfechos. Pero por qué el tercio restante no lo está sigue sin estar claro: qué les molesta exactamente, en qué momento surge la frustración, qué expectativa quedó sin cumplir – nada de eso está en los datos, porque el formato no puede capturarlo.

Lo que las encuestas nunca pudieron

Las encuestas miden distribuciones. Muestran cuántas personas eligen una respuesta determinada. Lo que no muestran: por qué alguien responde como lo hace. La distinción suena técnica; es fundamental.

Una escala Likert del 1 al 5 comprime una opinión matizada en una categoría. Según un estudio de PLOS ONE, esto produce pérdidas significativas de información – la categorización discreta simplifica lo que no se deja simplificar. A eso se suma el sesgo de deseabilidad social: las personas responden como creen que se espera de ellas, no como realmente piensan. Investigadores del PNAS demostraron que estas distorsiones no son casos aislados, sino que falsean sistemáticamente los autoinformes.

A esto se añade la aquiescencia – la tendencia a estar de acuerdo con las afirmaciones independientemente de su contenido – y la evitación de posiciones extremas, especialmente en temas sensibles. Lo que termina en la base de datos no es la opinión del encuestado; es un artefacto del formato.

El campo de texto libre al final de la encuesta – "¿Desea añadir algo más?" – debería cerrar esa brecha. En la práctica, casi nadie escribe más de una frase, si es que escribe algo. Después de 15 minutos marcando casillas, nadie invierte un minuto más en texto libre.

Los números detrás del declive

Las tasas de respuesta de las encuestas llevan dos décadas cayendo. Lo que Pew Research documentó para las encuestas telefónicas – una caída del 36 al seis por ciento entre 1997 y 2018 – se repite ahora con las encuestas online. Las encuestas por email alcanzan según Clootrack entre el 15 y el 25 por ciento de los destinatarios, con tendencia a la baja.

Quienes todavía responden lo hacen con cada vez menos dedicación: el 70 por ciento de los encuestados ha abandonado alguna vez una encuesta antes de terminarla. Los datos que acaban en el análisis no reflejan opiniones; reflejan impaciencia.

Un estudio controlado de la Universidad de Mannheim cuantifica la diferencia. Aylin Idrizovski y el Dr. Florian Stahl hicieron que 100 personas respondieran a las mismas preguntas – la mitad mediante un cuestionario online clásico, la otra en una entrevista moderada por IA. El formato de entrevista generó un 39 por ciento más de palabras por respuesta, un 36 por ciento más de temas identificados y una diversidad léxica considerablemente mayor. Las respuestas incoherentes, el llamado gibberish, no aparecieron en absoluto en las entrevistas; en los cuestionarios, representaron el diez por ciento.

Los participantes también valoraron las entrevistas con IA con mayor satisfacción, reportaron una sensación más fuerte de ser escuchados y mostraron más confianza en el tratamiento de sus datos.

Qué hacen diferente las entrevistas moderadas por IA

Un cuestionario es un monólogo con casillas de verificación; una entrevista es una conversación. El tipo de información que emerge es fundamentalmente distinto.

En una entrevista moderada por IA, el participante responde a una pregunta abierta – y la IA repregunta. No con una pregunta predefinida, sino con una que surge de la respuesta. Cuando alguien dice "el checkout fue frustrante", la IA no pregunta "¿cuánto de frustrante en una escala del 1 al 5?", sino "¿qué fue exactamente lo que te frustró?" Si la respuesta se queda en la superficie, profundiza de nuevo. Cinco, seis, siete niveles, hasta que la razón real está sobre la mesa.

Funciona porque la IA no tiene agenda. Un entrevistador humano llega con hipótesis, interpreta el tono de voz y las expresiones, orienta inconscientemente hacia respuestas que confirman sus suposiciones. No es un reproche; es un fenómeno documentado en la investigación cualitativa. La IA sigue la respuesta, no sus propias expectativas.

A eso se suma la disponibilidad. Un moderador humano realiza tres o cuatro entrevistas al día, necesita pausas, tiene agenda. Una IA conduce cientos de entrevistas simultáneamente – de noche, en fin de semana, en el idioma del participante. Eso no solo cambia la velocidad; cambia quién puede participar.

Cuali + cuanti: el nuevo terreno intermedio

La frontera entre investigación cualitativa y cuantitativa siempre fue una cuestión de recursos. Cualitativo significaba: insights profundos, muestra pequeña. Cuantitativo: distribuciones amplias, sin profundidad. Había que elegir.

Con las entrevistas moderadas por IA, ya no. Se puede hacer que 200 personas participen en una conversación de 30 minutos – en 48 horas en vez de seis semanas. El resultado no es ni un proyecto cuali clásico ni una encuesta, sino algo intermedio: profundidad cualitativa a escala cuantitativa.

Así funciona en nuestro caso: un researcher define la guía de entrevista y las preguntas de investigación. La IA conduce las conversaciones. El pipeline de análisis extrae patrones de las transcripciones – similitudes semánticas, clusters temáticos, trayectorias de sentimiento. Lo que manualmente llevaría semanas está disponible como informe estructurado en uno o dos días.

Esto transforma la dinámica de los proyectos de investigación. Cuando investigar ya no cuesta seis semanas y 15.000 euros, desaparece la excusa más habitual: "Ahora mismo no tenemos presupuesto." La investigación se convierte en algo que se hace antes de cada decisión de producto importante, no solo una vez al trimestre.

Cuándo las encuestas siguen teniendo sentido

Las encuestas no son inútiles, sino una herramienta concreta para preguntas concretas.

El benchmarking funciona bien con encuestas. Si envías el mismo cuestionario NPS cuatro veces al año y sigues la tendencia, no necesitas una entrevista. Las métricas estandarizadas como CSAT o CES tienen su valor como sismógrafo: muestran que algo ha cambiado, aunque no muestren qué.

Para grandes estudios demográficos centrados en distribuciones – cuántos, con qué frecuencia, qué grupo de edad –, el cuestionario sigue siendo el método más eficiente. Y para preguntas de screening que precualifican participantes para conversaciones más profundas, las encuestas cortas siguen siendo la opción adecuada.

La pregunta no es "encuesta o entrevista", sino "¿qué información necesito?" Si quieres saber cuántos de tus usuarios conocen una funcionalidad, usa una encuesta. Si quieres saber por qué no la usan, inicia una conversación.

Pruébalo tú mismo

Es difícil describir cómo se siente una entrevista moderada por IA. Lo mejor es experimentarlo. Estamos realizando un estudio abierto – 20 minutos, sin registro, directamente en el navegador.

Preguntas frecuentes

¿Pueden las entrevistas moderadas por IA reemplazar completamente las encuestas?

No. Para tracking estandarizado (NPS, CSAT), grandes estudios demográficos y benchmarking, las encuestas siguen siendo la herramienta adecuada. Las entrevistas con IA sustituyen a las encuestas donde importa el porqué – en cualquier contexto donde las preguntas abiertas, las repreguntas y la comprensión del contexto son determinantes.

¿Qué tan válidos son los resultados de las entrevistas moderadas por IA?

En un estudio controlado de la Universidad de Mannheim, las entrevistas moderadas por IA produjeron datos significativamente más ricos y cero respuestas incoherentes ante preguntas idénticas – frente a un diez por ciento de gibberish en los cuestionarios tradicionales. Los participantes también valoraron la experiencia de entrevista con mayor satisfacción que el formato de cuestionario.

¿Cuánto cuesta una entrevista moderada por IA comparada con una encuesta?

Una encuesta con 1.000 participantes cuesta entre 2.000 y 10.000 euros según panel y complejidad, y entrega distribuciones cuantitativas. Un proyecto de investigación cualitativa con 10 a 20 entrevistas moderadas por humanos cuesta entre 12.500 y 25.000 euros. Las entrevistas moderadas por IA ofrecen profundidad cualitativa a una fracción del coste tradicional, pudiendo incluir cientos de participantes simultáneamente.

¿Los participantes saben que hablan con una IA?

Sí, y es intencionado. La transparencia sobre el uso de IA no es solo un requisito legal bajo el AI Act europeo – en la práctica mejora la apertura de las respuestas. Las personas hablan con más honestidad con una IA que con un entrevistador humano, porque el sesgo de deseabilidad social desaparece.