I sondaggi raggiungono ogni anno meno persone. E chi risponde spunta caselle invece di riflettere. Il formato che per decenni è stato lo strumento standard per raccogliere il feedback degli utenti sta raggiungendo un limite strutturale – e uno studio controllato dell'Università di Mannheim dimostra che le interviste moderate dall'IA producono dati sensibilmente più ricchi, più differenziati e più puliti rispetto ai questionari tradizionali.

Chi vuole migliorare un prodotto ricorre quasi per riflesso al sondaggio. Dieci domande, un blocco di scale Likert, un campo di testo libero alla fine. Il vantaggio è evidente: veloce da creare, economico da distribuire, facile da quantificare. Migliaia di risposte in una settimana, grafici nel report trimestrale – tutto sembra guidato dai dati e solido.

Il problema emerge quando si prova a lavorare con i risultati. I numeri dicono: due terzi sono soddisfatti. Ma perché l'altro terzo non lo sia resta oscuro: cosa li infastidisce esattamente, in quale momento nasce la frustrazione, quale aspettativa è rimasta disattesa – niente di tutto ciò compare nei dati, perché il formato non è in grado di catturarlo.

Ciò che i sondaggi non hanno mai potuto fare

I sondaggi misurano distribuzioni. Mostrano quante persone scelgono una determinata risposta. Quello che non mostrano: perché qualcuno risponde in un certo modo. La distinzione sembra tecnica; è fondamentale.

Una scala Likert da 1 a 5 comprime un'opinione sfumata in una categoria. Secondo uno studio di PLOS ONE, questo comporta una significativa perdita di informazioni – la categorizzazione discreta semplifica ciò che non si lascia semplificare. A questo si aggiunge il bias di desiderabilità sociale: le persone rispondono come credono ci si aspetti da loro, non come pensano realmente. Ricercatori del PNAS hanno dimostrato che queste distorsioni non sono casi isolati, ma falsano sistematicamente le autovalutazioni.

C'è poi l'acquiescenza – la tendenza a concordare con le affermazioni indipendentemente dal contenuto – e l'evitamento delle posizioni estreme, specialmente sui temi sensibili. Ciò che finisce nel database non è l'opinione del rispondente; è un artefatto del formato.

Il campo di testo libero alla fine del sondaggio – "Desidera aggiungere qualcosa?" – dovrebbe colmare questa lacuna. Nella pratica, quasi nessuno scrive più di una frase, ammesso che scriva qualcosa. Dopo 15 minuti di caselle da spuntare, nessuno investe un altro minuto nel testo libero.

I numeri dietro il declino

I tassi di risposta dei sondaggi calano da due decenni. Quello che Pew Research ha documentato per le indagini telefoniche – un calo dal 36 al sei per cento tra il 1997 e il 2018 – si sta ripetendo con i sondaggi online. I sondaggi via email raggiungono ancora secondo Clootrack tra il 15 e il 25 per cento dei destinatari, con tendenza al ribasso.

Chi ancora risponde lo fa con sempre meno cura: il 70 per cento dei rispondenti ha abbandonato almeno una volta un sondaggio prima di completarlo. I dati che finiscono nell'analisi non riflettono opinioni; riflettono impazienza.

Uno studio controllato dell'Università di Mannheim rende la differenza misurabile. Aylin Idrizovski e il Dr. Florian Stahl hanno fatto rispondere 100 persone alle stesse domande – metà tramite un questionario online classico, l'altra metà in un'intervista moderata dall'IA. Il formato intervista ha prodotto il 39 per cento in più di parole per risposta, il 36 per cento in più di temi identificati e una diversità lessicale sensibilmente superiore. Le risposte prive di senso, il cosiddetto gibberish, non si sono presentate affatto nelle interviste; nei questionari, rappresentavano il dieci per cento.

I partecipanti hanno inoltre valutato le interviste con l'IA con una soddisfazione più alta, hanno riferito una sensazione più forte di essere ascoltati e hanno mostrato maggiore fiducia nel trattamento dei propri dati.

Cosa fanno di diverso le interviste moderate dall'IA

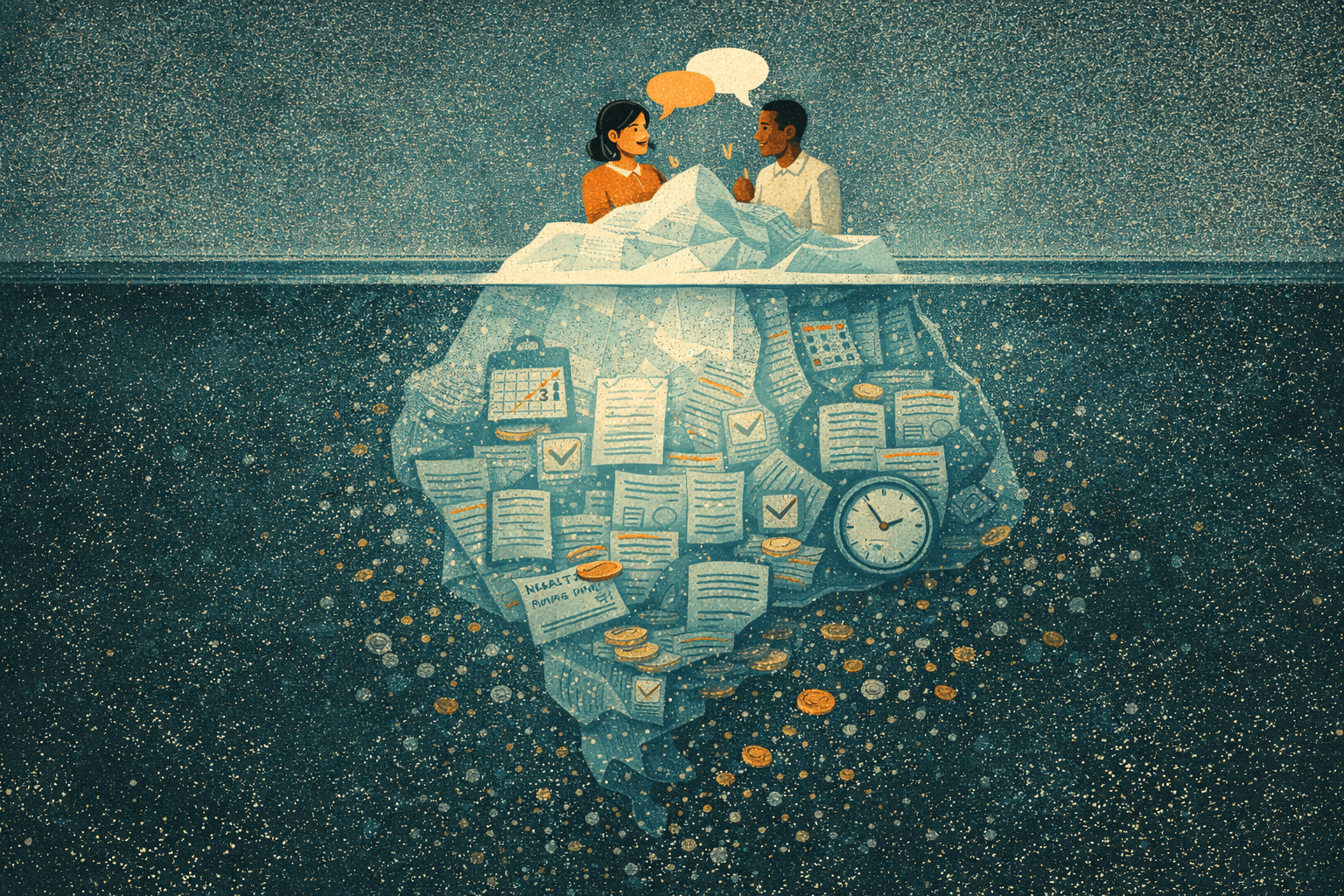

Un questionario è un monologo con caselle di spunta; un'intervista è una conversazione. Il tipo di informazione che ne emerge è fondamentalmente diverso.

In un'intervista moderata dall'IA, il partecipante risponde a una domanda aperta – e l'IA approfondisce. Non con una domanda predefinita, ma con una che nasce dalla risposta. Quando qualcuno dice "il checkout è stato frustrante", l'IA non chiede "quanto frustrante su una scala da 1 a 5?" ma "cosa ti ha frustrato esattamente?" Se la risposta resta in superficie, indaga ancora. Cinque, sei, sette livelli di profondità, fino a quando il vero motivo è sul tavolo.

Funziona perché l'IA non ha un'agenda. Un intervistatore umano arriva con ipotesi, interpreta il tono di voce e le espressioni, orienta inconsciamente verso risposte che confermano i suoi presupposti. Non è un'accusa; è un fenomeno documentato nella ricerca qualitativa. L'IA segue la risposta, non le proprie aspettative.

Si aggiunge la disponibilità. Un moderatore umano conduce tre o quattro interviste al giorno, ha bisogno di pause, ha un'agenda. Un'IA conduce centinaia di interviste contemporaneamente – di notte, nel fine settimana, nella lingua del partecipante. Questo non cambia solo la velocità; cambia chi può partecipare.

Quali + quanti: il nuovo terreno intermedio

Il confine tra ricerca qualitativa e quantitativa è sempre stato una questione di risorse. Qualitativo significava: insight profondi, campione piccolo. Quantitativo: distribuzioni ampie, nessuna profondità. Bisognava scegliere.

Con le interviste moderate dall'IA non è più così. Si possono far partecipare 200 persone a una conversazione di 30 minuti – in 48 ore anziché sei settimane. Il risultato non è né un progetto quali classico né un sondaggio, ma qualcosa nel mezzo: profondità qualitativa su scala quantitativa.

Da noi funziona così: un researcher definisce la guida dell'intervista e le domande di ricerca. L'IA conduce le conversazioni. La pipeline di analisi estrae pattern dalle trascrizioni – similarità semantiche, cluster tematici, traiettorie di sentiment. Quello che richiederebbe settimane manualmente è disponibile in uno o due giorni come report strutturato.

Questo cambia la dinamica dei progetti di ricerca. Quando la ricerca non costa più sei settimane e 15.000 euro, scompare la scusa più frequente: "In questo momento non abbiamo il budget." La ricerca diventa qualcosa che si fa prima di ogni decisione di prodotto importante, non solo una volta al trimestre.

Quando i sondaggi hanno ancora senso

I sondaggi non sono inutili – sono uno strumento specifico per domande specifiche.

Il benchmarking funziona bene con i sondaggi. Se invii lo stesso questionario NPS quattro volte l'anno e segui il trend, non hai bisogno di un'intervista. Le metriche standardizzate come CSAT o CES hanno il loro valore come sismografo: mostrano che qualcosa è cambiato, anche se non mostrano cosa.

Per grandi studi demografici incentrati sulle distribuzioni – quanti, con quale frequenza, quale fascia d'età –, il questionario resta il metodo più efficiente. E per le domande di screening che prequalificano i partecipanti per conversazioni più approfondite, i sondaggi brevi restano lo strumento adatto.

La domanda non è "sondaggio o intervista" ma "di quale informazione ho bisogno?" Se vuoi sapere quanti dei tuoi utenti conoscono una funzionalità, usa un sondaggio. Se vuoi sapere perché non la usano, avvia una conversazione.

Provalo tu stesso

È difficile descrivere come ci si sente in un'intervista moderata dall'IA. Il modo migliore è sperimentarlo. Stiamo conducendo uno studio aperto – 20 minuti, senza registrazione, direttamente nel browser.

Domande frequenti

Le interviste moderate dall'IA possono sostituire completamente i sondaggi?

No. Per il tracking standardizzato (NPS, CSAT), i grandi studi demografici e il benchmarking, i sondaggi restano lo strumento giusto. Le interviste con l'IA sostituiscono i sondaggi dove conta il perché – ovunque le domande aperte, gli approfondimenti e la comprensione del contesto siano determinanti.

Quanto sono validi i risultati delle interviste moderate dall'IA?

In uno studio controllato dell'Università di Mannheim, le interviste moderate dall'IA hanno prodotto dati significativamente più ricchi e zero risposte incoerenti a fronte di domande identiche – contro un dieci per cento di gibberish nei questionari tradizionali. I partecipanti hanno inoltre valutato l'esperienza dell'intervista con una soddisfazione più alta rispetto al formato questionario.

Quanto costa un'intervista moderata dall'IA rispetto a un sondaggio?

Un sondaggio con 1.000 partecipanti costa tra 2.000 e 10.000 euro a seconda del panel e della complessità, e fornisce distribuzioni quantitative. Un progetto di ricerca qualitativa con 10-20 interviste moderate da un umano costa tra 12.500 e 25.000 euro. Le interviste moderate dall'IA offrono profondità qualitativa a una frazione del costo tradizionale, potendo includere centinaia di partecipanti contemporaneamente.

I partecipanti sanno di parlare con un'IA?

Sì, ed è intenzionale. La trasparenza sull'uso dell'IA non è solo un obbligo legale ai sensi dell'AI Act europeo – nella pratica migliora l'apertura delle risposte. Le persone parlano con maggiore onestà con un'IA rispetto a un intervistatore umano, perché il bias di desiderabilità sociale viene meno.