Les sondages touchent chaque année moins de personnes. Et ceux qui répondent cochent des cases plutôt que de réfléchir. Le format qui a servi de référence pour recueillir le feedback des utilisateurs pendant des décennies atteint une limite structurelle – et une étude contrôlée de l'Université de Mannheim montre que les entretiens modérés par l'IA produisent des données nettement plus riches, plus nuancées et plus propres que les questionnaires classiques.

Pour améliorer un produit, le réflexe est quasi automatique : lancer un sondage. Dix questions, un bloc d'échelles de Likert, un champ texte libre à la fin. L'avantage est évident : rapide à créer, peu coûteux à distribuer, facile à quantifier. Des milliers de réponses en une semaine, des graphiques dans le rapport trimestriel – tout semble solide et piloté par la donnée.

Le problème apparaît quand on veut exploiter les résultats. Les chiffres disent : deux tiers des utilisateurs sont satisfaits. Mais pourquoi l'autre tiers ne l'est pas reste opaque : ce qui les gêne précisément, à quel moment la frustration survient, quelle attente n'a pas été remplie – rien de tout cela ne figure dans les données, parce que le format ne permet pas de le capturer.

Ce que les sondages n'ont jamais pu faire

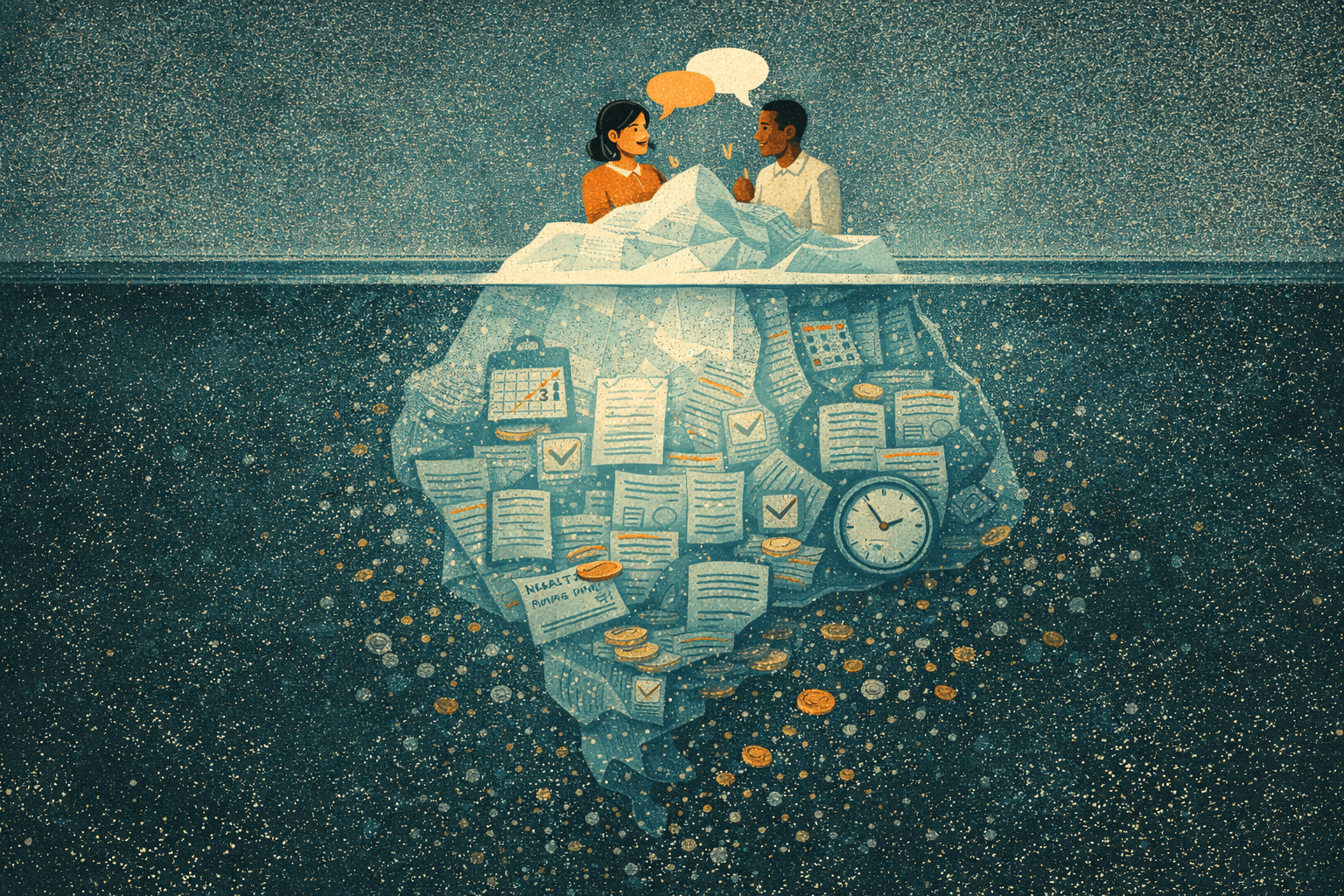

Les sondages mesurent des distributions. Ils montrent combien de personnes choisissent telle ou telle réponse. Ce qu'ils ne montrent pas : pourquoi quelqu'un répond comme il le fait. La distinction paraît technique ; elle est fondamentale.

Une échelle de Likert de 1 à 5 compresse un avis nuancé dans une catégorie. Selon une étude PLOS ONE, cela entraîne une perte d'information significative – la catégorisation discrète simplifie ce qui résiste à la simplification. S'y ajoute le biais de désirabilité sociale : les gens répondent comme ils pensent qu'on attend d'eux, pas comme ils pensent réellement. Des chercheurs du PNAS ont montré que ces distorsions ne sont pas marginales mais faussent systématiquement les auto-évaluations.

Il y a aussi l'acquiescement – la tendance à approuver les énoncés indépendamment de leur contenu – et l'évitement des positions extrêmes, surtout sur les sujets sensibles. Ce qui finit dans la base de données n'est pas l'opinion du répondant ; c'est un artefact du format.

Le champ texte libre en fin de questionnaire – « Souhaitez-vous ajouter quelque chose ? » – est censé combler cette lacune. En pratique, presque personne n'y écrit plus d'une phrase, quand on y écrit quelque chose. Après 15 minutes de cases à cocher, personne n'investit une minute supplémentaire dans du texte libre.

Les chiffres derrière le déclin

Les taux de réponse des sondages baissent depuis deux décennies. Ce que Pew Research a documenté pour les enquêtes téléphoniques – une chute de 36 à six pour cent entre 1997 et 2018 – se reproduit avec les sondages en ligne. Les sondages par e-mail atteignent encore 15 à 25 pour cent des destinataires selon Clootrack, tendance à la baisse.

Ceux qui répondent encore le font avec de moins en moins de soin : 70 pour cent des répondants ont déjà abandonné un sondage avant de le terminer. Les données qui finissent dans l'analyse ne reflètent pas des opinions ; elles reflètent de l'impatience.

Une étude contrôlée de l'Université de Mannheim rend la différence mesurable. Aylin Idrizovski et le Dr. Florian Stahl ont fait répondre 100 personnes aux mêmes questions – la moitié via un questionnaire en ligne classique, l'autre dans un entretien modéré par l'IA. Le format entretien a produit 39 pour cent de mots en plus par réponse, 36 pour cent de thèmes identifiés en plus et une diversité lexicale nettement supérieure. Les réponses incohérentes, dites gibberish, étaient totalement absentes des entretiens ; dans les questionnaires, elles représentaient dix pour cent des réponses.

Les participants ont également attribué une satisfaction plus élevée aux entretiens IA, rapporté un sentiment plus fort d'être écoutés et montré davantage de confiance dans le traitement de leurs données.

Ce que les entretiens modérés par l'IA changent

Un questionnaire est un monologue à cases à cocher ; un entretien est une conversation. Le type d'information qui en résulte est fondamentalement différent.

Dans un entretien modéré par l'IA, le participant répond à une question ouverte – et l'IA relance. Non pas avec une question prédéfinie, mais avec une qui naît de la réponse. Quand quelqu'un dit « le paiement était frustrant », l'IA ne demande pas « à quel point sur une échelle de 1 à 5 ? » mais « qu'est-ce qui t'a frustré exactement ? » Si la réponse reste en surface, elle creuse encore. Cinq, six, sept niveaux de profondeur, jusqu'à ce que la vraie raison soit sur la table.

Cela fonctionne parce que l'IA n'a pas d'agenda. Un interviewer humain arrive avec des hypothèses, interprète le ton et les expressions, oriente inconsciemment vers des réponses qui confirment ses présupposés. Ce n'est pas un reproche ; c'est un phénomène documenté en recherche qualitative. L'IA suit la réponse, pas ses propres attentes.

S'ajoute la disponibilité. Un modérateur humain conduit trois à quatre entretiens par jour, a besoin de pauses, a un agenda. Une IA conduit des centaines d'entretiens simultanément – la nuit, le week-end, dans la langue du participant. Cela ne change pas seulement la rapidité ; cela change qui peut participer.

Quali + quanti : le nouveau terrain intermédiaire

La frontière entre recherche qualitative et quantitative a toujours été une question de moyens. Qualitatif signifiait : insights profonds, petit échantillon. Quantitatif : distributions larges, sans profondeur. Il fallait choisir.

Avec les entretiens modérés par l'IA, ce n'est plus nécessaire. On peut faire participer 200 personnes à une conversation de 30 minutes – en 48 heures au lieu de six semaines. Le résultat n'est ni un projet quali classique ni un sondage, mais quelque chose entre les deux : de la profondeur qualitative à l'échelle quantitative.

Chez nous, cela fonctionne ainsi : un researcher définit le guide d'entretien et les questions de recherche. L'IA mène les conversations. Le pipeline d'analyse extrait les patterns des transcriptions – similarités sémantiques, clusters thématiques, trajectoires de sentiment. Ce qui prendrait des semaines manuellement est disponible en un à deux jours sous forme de rapport structuré.

Cela change la dynamique des projets de recherche. Quand la recherche ne coûte plus six semaines et 15 000 euros, l'excuse la plus courante disparaît : « On n'a pas le budget en ce moment. » La recherche devient quelque chose qu'on fait avant chaque décision produit majeure, pas seulement une fois par trimestre.

Quand les sondages restent pertinents

Les sondages ne sont pas inutiles – c'est un outil spécifique pour des questions spécifiques.

Le benchmarking fonctionne bien avec les sondages. Si tu envoies le même questionnaire NPS quatre fois par an et que tu suis la tendance, tu n'as pas besoin d'entretien. Les métriques standardisées comme le CSAT ou le CES ont leur valeur de sismographe : elles montrent que quelque chose a changé, même si elles ne montrent pas quoi.

Pour les grandes études démographiques centrées sur les distributions – combien, à quelle fréquence, quelle tranche d'âge –, le questionnaire reste la méthode la plus efficiente. Et pour les questions de screening qui pré-qualifient des participants pour des conversations approfondies, les sondages courts restent l'outil de choix.

La question n'est pas « sondage ou entretien » mais « de quelle information ai-je besoin ? » Si tu veux savoir combien d'utilisateurs connaissent une fonctionnalité, lance un sondage. Si tu veux savoir pourquoi ils ne l'utilisent pas, lance une conversation.

Essaie par toi-même

Difficile de décrire ce que donne un entretien modéré par l'IA. Le mieux est de l'expérimenter. Nous menons actuellement une étude ouverte – 20 minutes, sans inscription, directement dans le navigateur.

Questions fréquentes

Les entretiens modérés par l'IA peuvent-ils complètement remplacer les sondages ?

Non. Pour le tracking standardisé (NPS, CSAT), les grandes études démographiques et le benchmarking, les sondages restent le bon outil. Les entretiens IA remplacent les sondages là où le pourquoi compte – partout où les questions ouvertes, les relances et la compréhension du contexte sont déterminantes.

Quelle est la validité des résultats des entretiens modérés par l'IA ?

Dans une étude contrôlée de l'Université de Mannheim, les entretiens modérés par l'IA ont produit des données significativement plus riches et zéro réponse incohérente face à des questions identiques – contre dix pour cent de gibberish dans les questionnaires classiques. Les participants ont également évalué l'expérience d'entretien avec une satisfaction plus élevée que le format questionnaire.

Combien coûte un entretien modéré par l'IA par rapport à un sondage ?

Un sondage avec 1 000 participants coûte entre 2 000 et 10 000 euros selon le panel et la complexité, et livre des distributions quantitatives. Un projet de recherche qualitative avec 10 à 20 entretiens modérés par un humain coûte 12 500 à 25 000 euros. Les entretiens modérés par l'IA offrent la profondeur qualitative à une fraction du coût des entretiens traditionnels, tout en intégrant des centaines de participants simultanément.

Les participants savent-ils qu'ils parlent à une IA ?

Oui, et c'est voulu. La transparence sur l'utilisation de l'IA n'est pas seulement une obligation légale au titre du AI Act européen – elle améliore en pratique l'ouverture des réponses. Les gens parlent plus honnêtement avec une IA qu'avec un interviewer humain, parce que le biais de désirabilité sociale disparaît.