Les personas générées par l'IA promettent une recherche utilisateur rapide et abordable à grande échelle. Mener des milliers d'entretiens en un après-midi, sauter le recrutement, obtenir des résultats en heures au lieu de semaines. Pour les équipes produit qui se noient dans les backlogs de recherche, cela ressemble à la solution. Mais que dit la recherche sur la façon dont les utilisateurs synthétiques représentent réellement les vraies personnes ?

Ce que sont les utilisateurs synthétiques – et ce qu'ils ne sont pas

Les utilisateurs synthétiques sont des profils générés par l'IA conçus pour simuler de vraies personnes. On alimente le système avec des données démographiques – âge, profession, lieu de résidence – et il produit une persona qui répond aux questions de recherche.

Certaines plateformes vont plus loin et promettent des jumeaux numériques basés sur de vraies données d'entretien. D'autres génèrent des utilisateurs entièrement fictifs à partir de modèles démographiques. La différence entre ces approches est énorme – et la plupart des plateformes vendent la deuxième option tout en laissant entendre qu'on obtient la première.

L'expérience Stanford-Google

Une étude de Stanford et Google avec plus de 1 000 participants a examiné systématiquement dans quelle mesure l'IA peut simuler de vraies personnes. La méthode était élaborée : d'abord, les chercheurs ont mené de vrais entretiens approfondis avec chaque participant. Puis ils ont entraîné une IA à imiter exactement cette personne.

Le résultat : 85% de précision pour prédire comment ces personnes répondraient à de nouvelles questions. C'est impressionnant – mais le piège réside dans la méthode elle-même. L'IA avait d'abord besoin de vraies conversations comme fondation. Elle n'a pas remplacé la recherche, mais a étendu ce qui avait déjà été appris à travers des conversations avec de vraies personnes.

La deuxième partie de l'expérience était plus décevante. Les chercheurs ont également testé des personas construites uniquement à partir de données démographiques : âge, genre, lieu, profession. La précision est tombée à peine mieux qu'un pile ou face.

Savoir que quelqu'un est une responsable marketing de 35 ans de Lyon ne dit presque rien sur comment elle se comporte réellement, ce qui la frustre ou pour quoi elle paierait.

Pourquoi les modèles de langage échouent à simuler les humains

Les modèles de langage génèrent ce qui semble plausible – pas ce qui est vrai. Quand on demande à un « client frustré » synthétique son expérience, l'IA puise dans des millions d'exemples textuels. Elle produit un composite convaincant qui ne correspond au comportement réel d'aucune vraie personne.

Le Nielsen Norman Group a rendu cela visible dans une comparaison directe. Ils ont interrogé des utilisateurs synthétiques et réels sur une plateforme d'apprentissage en ligne.

Les utilisateurs synthétiques ont rapporté : cours entièrement terminés, forums de discussion jugés utiles, navigation comprise intuitivement. Les vrais utilisateurs ont raconté une autre histoire : la plupart des cours abandonnés en cours de route, forums complètement évités, constamment perdus dans la navigation.

Les personas IA ont produit ce que les chercheurs appellent un feedback sycophantique – accommodant, positif, sans conflit. Exactement le type de feedback qui fait échouer les produits parce qu'il dit ce qu'on veut entendre au lieu de ce qu'on doit savoir.

Trois faiblesses systématiques

Cette divergence n'est pas fortuite – elle découle du fonctionnement des modèles de langage.

Biais de surconfiance

Les utilisateurs synthétiques rapportent un accomplissement parfait des tâches. Les vrais utilisateurs luttent, abandonnent des tâches, trouvent des contournements. Le chaos du comportement humain – les hésitations, les malentendus, les détours créatifs – ne rentre pas dans les récits ordonnés que l'IA génère.

Cas limites manquants

Les personas IA se regroupent autour du comportement mainstream. Les power users, les personnes avec des besoins d'accessibilité, les usages inattendus sont systématiquement sous-représentés. Or ce sont souvent précisément ces cas limites qui révèlent les plus grandes opportunités et les problèmes les plus critiques.

Représentation biaisée

Les données d'entraînement ne représentent pas tous les groupes de manière égale. Certaines démographies, dialectes et perspectives apparaissent moins fréquemment. Les personas synthétiques héritent de ces lacunes et les amplifient – enveloppées dans l'autorité des données, ce qui rend le biais plus difficile à repérer.

Quand les utilisateurs synthétiques peuvent quand même être utiles

Malgré ces limitations, il existe des situations où les utilisateurs synthétiques peuvent contribuer – tant qu'on connaît leurs limites.

Pour la génération précoce d'hypothèses, avant même de savoir quelles questions sont pertinentes, ils peuvent faire émerger des possibilités. Ce sont des partenaires de brainstorming, pas des sujets de recherche.

Pour tester les guides d'entretien, les personas synthétiques peuvent révéler des formulations confuses. Si une IA comprend mal une question, les vrais utilisateurs la comprendront probablement mal aussi.

Pour jouer des variations, après que la vraie recherche a identifié un pattern concret : Et si ce type d'utilisateur avait aussi la contrainte X ? Ici l'IA peut aider à réfléchir aux implications – bien que les résultats restent des hypothèses, pas des faits.

Quand les éviter

Tester de nouveaux concepts uniquement avec des utilisateurs synthétiques est risqué. Leur feedback positif est sans signification parce qu'il découle de la structure des modèles de langage, pas d'une vraie expérience.

Pour des groupes cibles spécialisés – qu'il s'agisse de professionnels médicaux, d'ingénieurs industriels ou de personnes avec des handicaps spécifiques – les personas IA génériques ne sont pas seulement inutiles, elles sont dangereuses. Elles induisent activement en erreur parce qu'elles simulent une expertise qu'elles n'ont pas.

Tout ce qui concerne les émotions – confiance, peur, frustration, enthousiasme – nécessite de vraies personnes. L'IA simule des réponses émotionnelles sur la base de patterns textuels. Elle ne les vit pas, et cette différence se voit dans les données.

Et toute décision qui engage des ressources significatives nécessite une vraie validation. Ce n'est pas une question de préférence, mais de gestion des risques.

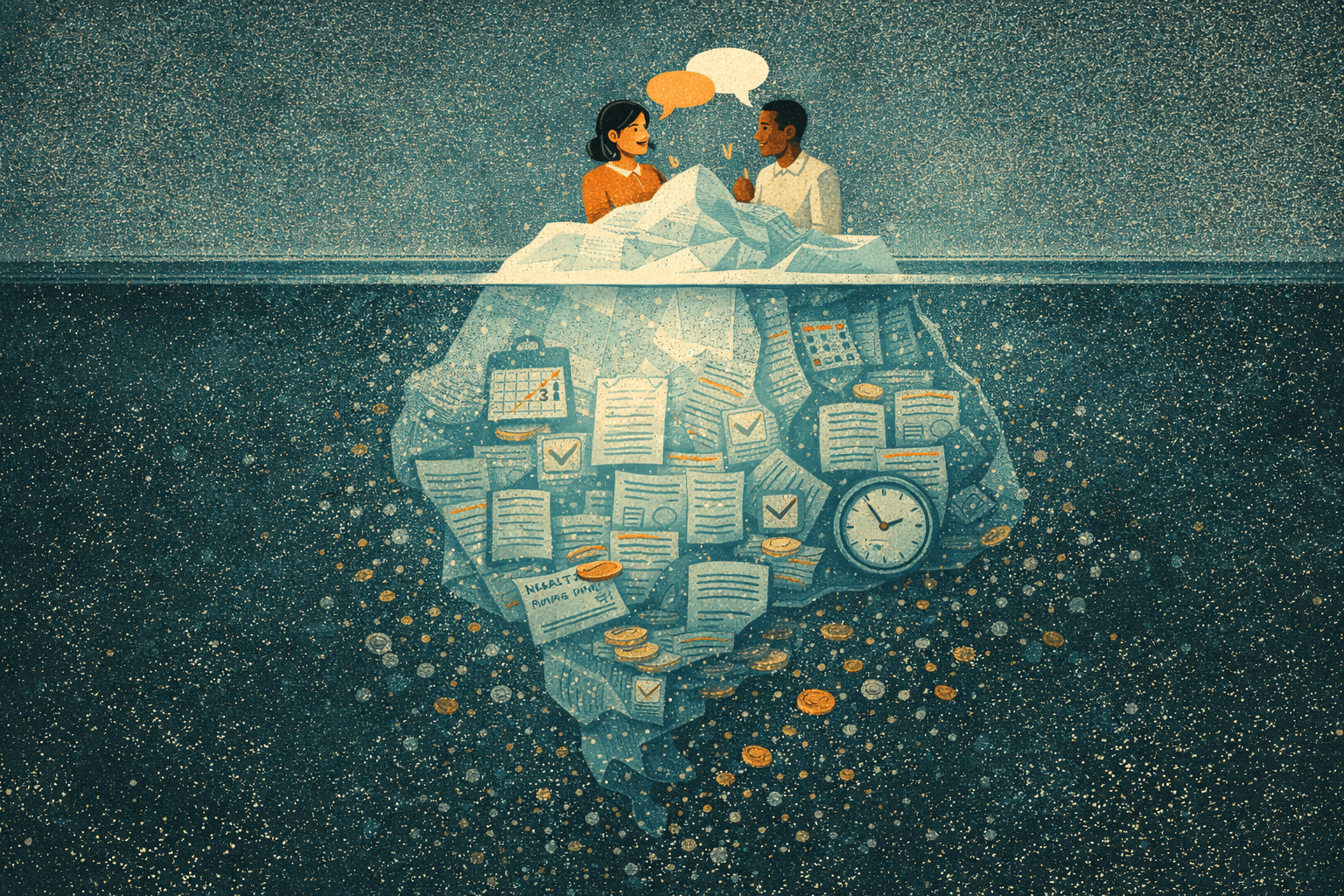

La meilleure voie : recherche réelle assistée par l'IA

La force de l'IA ne réside pas dans le remplacement des personnes, mais dans le fait de rendre la vraie recherche plus efficace.

L'IA pour l'exécution et l'analyse : entretiens automatisés avec de vrais utilisateurs, transcription, codage initial, reconnaissance de patterns à travers de nombreuses conversations. Ici l'IA fait vraiment gagner du temps sans compromettre la qualité.

Les humains pour l'insight : jugement, empathie, reconnaissance des nuances, interprétation stratégique. Ce sont les parties qui comptent le plus – et que l'IA ne peut pas fournir.

L'IA pour la mise à l'échelle, mais seulement après que la vraie recherche a validé des patterns. Ensuite elle peut aider à réfléchir aux implications et variations.

Les humains pour la validation : les décisions finales reviennent toujours aux vrais utilisateurs.

Cette approche hybride combine la vitesse de l'IA avec la vérité humaine. Elle prend au sérieux ce que la recherche montre : que l'IA est un outil puissant – mais seulement quand elle s'appuie sur le fondement de vraies conversations avec de vraies personnes.

Questions fréquentes

Les utilisateurs synthétiques peuvent-ils remplacer les vraies interviews utilisateur ?

Non. Pour la recherche exploratoire et la validation finale, vous avez besoin de vrais humains. Les utilisateurs synthétiques peuvent compléter, jamais substituer.

Quel est le plus grand risque de la recherche avec utilisateurs synthétiques ?

Le problème de sycophantie. Les personas IA donnent un feedback excessivement positif et superficiel qui confirme ce que vous voulez entendre et rate des problèmes critiques qui vous aideraient vraiment à construire de meilleurs produits.

Les jumeaux IA basés sur des interviews sont-ils plus fiables ?

Oui, nettement. Stanford a trouvé 85% de précision quand l'IA était entraînée sur de vraies données d'entretien de cette personne spécifique. Mais vous avez toujours besoin de la vraie interview d'abord, ce qui signifie que vous n'économisez pas vraiment l'étape de recherche.

Quand la recherche avec utilisateurs synthétiques est-elle appropriée ?

Génération d'hypothèses, test de guides d'entretien et exploration de variations sur des patterns validés. Jamais pour la validation de concept ou les décisions finales.

Comment expliquer les limitations aux parties prenantes ?

Formulez clairement : les utilisateurs synthétiques génèrent des possibilités, pas des preuves. Toute découverte sur laquelle il vaut la peine d'agir nécessite une validation par de vrais utilisateurs. Si quelqu'un résiste, demandez-lui s'il parierait sa roadmap produit sur un pile ou face.

Les utilisateurs synthétiques sont un outil, pas une méthode. Utilisez-les pour générer des questions, puis répondez à ces questions avec de vraies personnes.